隐私

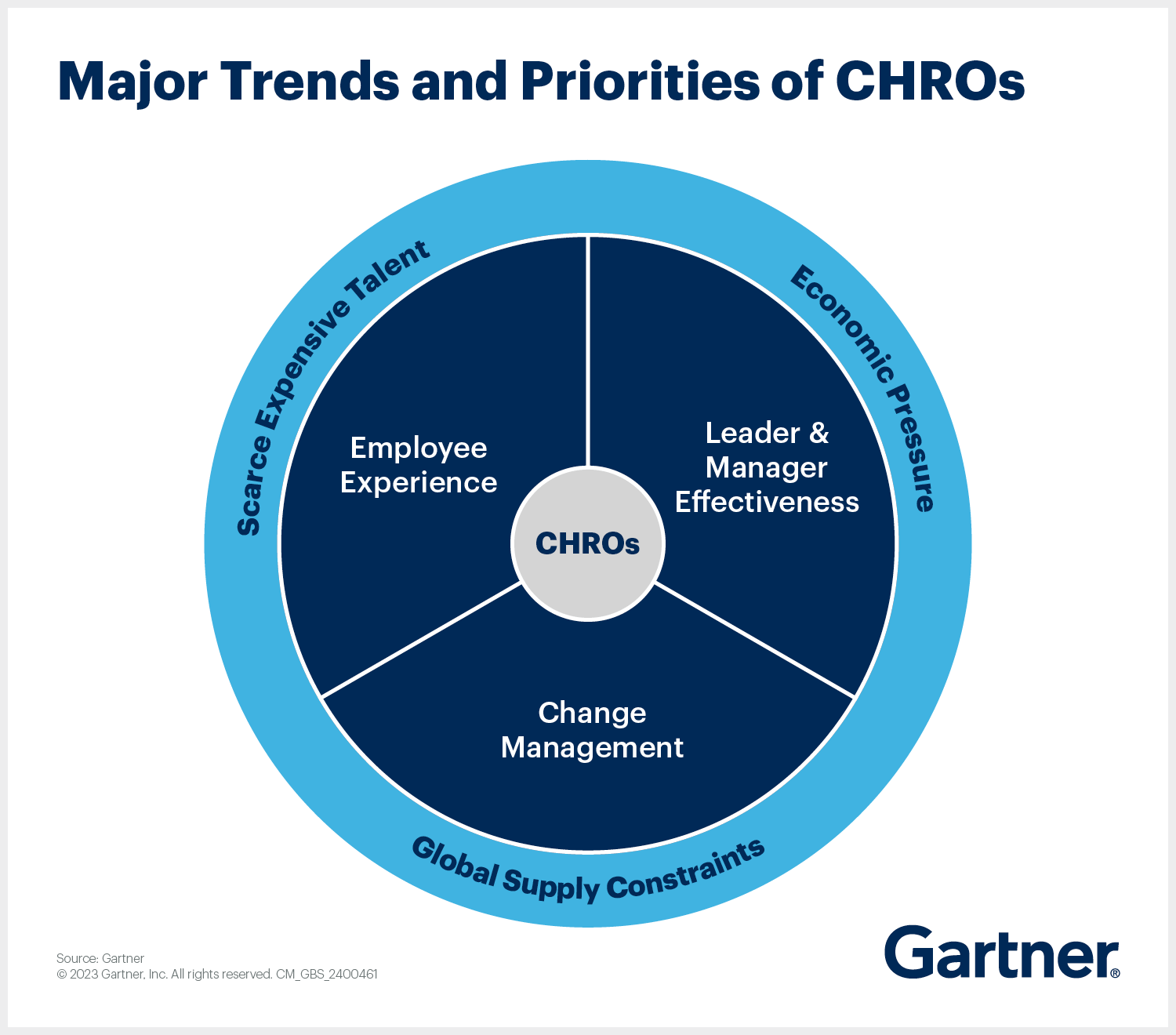

全面解析Gartner人力资源转型的四大关键要素

随着企业环境的快速变化,HR职能的转型已成为提升组织竞争力的关键所在。Gartner提出了人力资源转型的四个关键要素,涵盖领导力、运营模式、团队能力与技术支持,帮助企业应对不断变化的市场需求,优化人力资源的运营效率。

下面将详细介绍这四大要素,帮助企业HR领导者更好地理解和应用。

1. 卓越的HR领导力

成功的人力资源转型始于卓越的HR领导力。作为企业人力资本和文化的领导者,CHRO(首席人力资源官)需要从传统的职能管理角色转向更具战略性和前瞻性的业务伙伴。他们不仅要制定HR战略,还需根据市场变化和企业目标调整这些战略,确保HR职能能够支持业务需求。

CHRO的五大角色:

企业文化的引领者:塑造以人为本的企业文化,提升员工敬业度。

动态人才市场中的竞争者:面对人才短缺和高竞争的市场,制定具有竞争力的招聘和保留策略。

战略变革的推动者:推动企业战略转型,确保人力资源管理符合业务目标。

利益相关者的调和者:在不同部门和领导层之间平衡各种需求,推动跨部门协作。

值得信赖的顾问:为CEO和高层提供有力的决策支持。

2. 现代化的HR运营模式

HR的运营模式是HR转型的核心所在。现代化的HR运营模式强调灵活性和敏捷性,以应对企业的不断变化需求。根据Gartner的建议,HR运营模式的转型需从以下四个方面着手:

重新定义HRBP角色:HR业务伙伴(HRBP)的角色将从事务性管理者转型为战略人才领导者。他们需要具备更强的分析能力和战略思维,以推动各业务部门的人才管理策略。

创建HR问题解决专家团队:该团队作为HR的“弹性肌肉”,能够灵活应对各类战略性问题,开发并优化HR流程、政策和实践。

建立下一代卓越中心(COEs):未来的COEs将更加灵活,依赖于外部专业资源,与HR其他职能协同工作,确保HR政策和实践的专业性和灵活性。

打造HR运营和服务交付团队:通过HR技术支持和共享服务,HR运营团队能够更高效地服务于员工和管理层,确保企业日常运作顺利进行。

3. HR团队能力提升

HR团队的能力建设是HR转型成功的基石。随着混合工作模式的普及,企业对数据驱动的HR决策和战略性人才管理的需求愈发强烈。Gartner指出,HR团队需具备以下三大关键能力:

数据驱动的HR洞察力:HR团队需要掌握如何通过数据分析洞察员工行为和需求,并将这些数据转化为切实可行的战略决策。通过有效使用人才分析技术,HR可以找到关键人才的“热区”,制定针对性的培养和保留计划。

HRBP角色分化与专业化:HRBP将进一步细化为多个角色,包括战略人才领导者、问题解决专家和人员关系管理者。每个角色都需要具备项目管理、战略咨询和关系管理等核心能力。

跨部门创新与合作:HR不仅要提升内部能力,还需通过引入外部创新和跨部门合作来解决新出现的劳动力问题。HR应成为企业创新的推动者,引导跨部门合作,确保创新想法能够在企业内部落地。

4. HR技术支持

HR技术的进步为HR转型提供了强大动力。随着生成式AI、机器学习(ML)、自然语言处理(NLP)等技术的普及,HR流程的数字化转型加速推进。Gartner指出,HR技术的应用不仅应提升员工体验,还需帮助HR实现流程自动化和数字化,从而提升整体运营效率。

HR技术战略的核心:

以人为本的HR技术应用:HR技术的目标是为员工提供无缝的工作体验,确保技术在工作流程中发挥支撑作用,而非增加负担。

平衡技术投资与风险:HR技术领导者需在创新和成本之间找到平衡,确保技术投资既能推动业务转型,又能控制潜在风险。

数据安全与隐私保护:随着远程办公的普及,HR技术需确保员工数据的隐私和安全,采用更灵活的访问管理策略,防止数据泄露。

总结

人力资源的转型不仅仅是对现有流程和职能的升级,更是对HR领导力、运营模式、团队能力和技术支持的全面重构。通过Gartner提出的四大关键要素,企业HR团队能够更好地应对未来的挑战,提升业务支持能力,推动企业实现可持续发展。

详细可以访问Gartner的官网

隐私

【美国】工作场所安全解决方案公司Intenseye获得6400万美元B轮融资,推进其利用AI改造工作场所安全的使命

人工智能驱动的工作场所安全解决方案的领导者Intenseye获得6400万美元的B轮融资,由新投资者光速创投(Lightspeed Venture Partners)领投,现有投资者Insight Partners、Point Nine和Air Street Capital参投。Intenseye在过去的一年里主动检测了数千万个工作场所危险,并在全球六大洲实现了增长和扩张。

Intenseye 的企业级计算机视觉人工智能平台提供全天候的不安全行为和条件可见性,这些行为和条件发生在工伤或疾病之前,而人工审核往往无法发现这些行为和条件。该解决方案旨在增强环境健康与安全(EHS)团队的能力,以推动变革,提高效率,简化合规性,并最终在不损害工人隐私的情况下帮助预防工作场所事故。

通过最新一轮融资,Intenseye 将扩大其技术生态系统,为客户的现有基础设施释放更大的价值,进一步整合大型语言模型(LLM)和移动支持,以优化数十种使用案例,并继续投资于隐私创新,包括即将推出的 Gen AI 视频匿名功能,以重申其对人工智能道德和促进其所保护的工人心理安全的承诺。

"Intenseye首席执行官Sercan Esen表示:"工作场所事故的范围、规模和成本正在迅速攀升,这凸显了对人工智能驱动型解决方案的迫切需要,这些解决方案有助于准确定位和减轻危险,同时符合准确性、隐私和企业就绪性的最高标准。"Intenseye不仅仅是一个'不错的选择'--我们很自豪能够站在早该进行的转型的最前沿,让EHS领导者能够更有效、更高效地保护他们的一线团队。我们很荣幸数十家财富500强创新企业依靠Intenseye来改变其设施内的工作场所安全状况"。

据喜力墨西哥公司数字与技术供应链经理Miguel Ángel Aguilera Rodríguez说:"通过不断致力于流程改进和采用尖端技术,我们坚定地履行了提供安全健康工作环境的承诺。Intenseye是推进这些努力的重要盟友。该平台使我们能够实时洞察领先指标,帮助我们推动主动改进,降低一线团队面临的风险。

转变工作场所安全的迫切需要

国际劳工组织报告称,全球每年有近 300 万人死于工伤事故和疾病,每年有近 4 亿人遭受非致命工伤。美国工业卫生协会的一项研究证实,全球每年因工作场所事故造成的直接和间接经济损失估计近 3 万亿美元;仅美国每年因意外停工造成的损失估计就达 500 亿美元。

Intenseye 是唯一一家将全套高度先进且完全不可逆的隐私保护措施作为标准嵌入其产品的计算机视觉人工智能工作场所安全解决方案提供商。与其他供应商的产品不同,Intenseye 的解决方案保证工人的匿名性,从所有捕获的视频中剥离个人身份信息。

"Esen补充说:"我们对设计隐私的人工智能道德原则的承诺使我们与众不同,它有助于保护工人的心理安全,同时为他们的人身安全提供无与伦比的保护。

"光速公司的合伙人Alex Kayyal说:"我们光速公司对Serhat Cillidag,联合创始人兼首席技术官的独特见解印象深刻,他们利用人工智能和计算机视觉的力量推动了行业转型。"Intenseye已迅速成为健康与安全领导者事实上的'必备品',这些领导者每天都依赖于他们的平台,其中包括一些世界领先的品牌。Intenseye的核心人工智能平台解决了各行各业的根本痛点--我们很高兴能与他们合作,支持他们改变工作场所安全的使命。"

2023: 值得纪念的一年

Intenseye近期取得的里程碑式增长巩固了其在行业中的独特地位。公司的 B 轮融资是有史以来对人工智能驱动的工作场所安全创新的最大投资,使 Intenseye 的融资总额超过 9000 万美元,巩固了其在该领域资金最雄厚公司的地位。

更具体地说,2023 年,公司的全球业务增长了 125%。它与领先的保险公司、顶级云计算和 EHS 技术供应商以及其他著名的软件和硬件供应商建立了行业首创的合作伙伴关系,将 Intenseye 定位为全球数字化转型的重要组成部分。Intenseye的发展势头还体现在其广泛的覆盖面和影响力上,其业务遍及25个国家30多个行业的数千个场所,保护着全球10万多名工人的安全。

此外,Intenseye还在2023年加强了其位于纽约市的市场执行团队,招聘了一些重要人员,包括销售副总裁Matt Marshall、合作关系负责人Sean Snyder、财务负责人Steve Iannucci和营销负责人Chelsea Haynes。

"Intenseye 是一家堪称典范的人工智能先行公司,"Air Street Capital 合伙人 Nathan Benaich 说。"该团队抓住了现实世界中一个耗资数千亿美元但却隐藏在众目睽睽之下的问题。通过在现有但未得到充分利用的摄像头投资基础上进行构建,Intenseye 增加了全天候安全智能,推动全球劳动力服务发生可衡量的变化。从Sercan和他的团队踏上征程的第一天起,我们就为他们提供了支持,对此我们深感自豪。

关于Intenseye

Intenseye 是一家快速成长的技术公司,由专注于企业软件和人工智能的世界级风险投资公司提供支持。全世界每年因工伤造成的人力和经济损失高达惊人的 2500 亿美元。在 Intenseye,他们认为工人的健康与安全不容商量。Intenseye 建立了一个人工智能驱动的 HSE 平台,帮助全球最大的企业在其设施范围内扩展员工健康与安全。利用计算机视觉领域的最新突破,Intenseye 让健康与安全团队能够全天候监控其设施,接收实时违规通知,并实施快速反应程序。高性能软件和 IP 网络摄像机首次实现了全天候自动检查和实时事件通知。

隐私

【观点】人力资源领导者利用人工智能所需的技能

人力资源领域的人工智能(AI)是未来的潮流。支持AI的工具和技术可用于简化工作流程、自动化数据管理和增强人员分析能力。人力资源领导者和专业人士正在迅速借助人工智能的力量,在招聘、管理绩效数据和制定更好的员工保留策略方面做出更明智的决策。

2019年,我们的调查发现,在接受调查的人力资源专业人士中,46%的人将在2023年之前在人力资源管理中使用人工智能。而到2022年12月,麦肯锡的研究发现,50%的受访机构已经在其组织中采用了人工智能。他们发现,今天的人工智能采用率是2017年的2.5倍。

显然,人工智能的使用在现代商业世界中变得越来越普遍。然而,数据驱动的见解和人工智能工具只有在人力资源专业人员具备利用它们的正确技能时才能有效。换句话说,人力资源专业人员需要技术、分析和软技能的结合,以实现人工智能在人力资源和人员分析中的作用。这些技能可以包括:

技术熟练程度

人力资源领导者和专业人士应该对人工智能技术、其应用和局限性有深刻的了解,以评估和实施人工智能驱动的人力资源解决方案。例如,如果他们熟悉可用的不同人工智能技术,例如机器学习、自然语言处理和预测分析,他们可以确定使用哪种技术来有效地满足他们的人力资源目标。

人力资源数据通常包含有关员工的敏感信息,处理不当会严重影响组织及其员工的工作状态。因此,人力资源主管还必须对人员分析附带的数据管理、数据隐私和安全协议有很好的了解。

人力资源数据分析

人力资源数据很复杂,包含广泛的信息,例如员工人口统计、工作绩效指标以及招聘和培训数据等,这些信息可能会影响从员工福祉到职业发展的方方面面。

为了在人力资源中有效利用人工智能,人力资源领导者必须能够从这些数据中提取见解,并使用这些数据来为决策过程提供信息。因此,他们应该对统计方法和数据分析技术有深刻的理解,以便有效地收集、处理和分析数据,从而改进决策。他们还应该对仪表板和图形等数据可视化技术有很好的了解,以清晰有效的方式传达数据驱动的见解。

沟通技巧

有效的沟通对于人力资源专业人员建立信任、与其他部门协作和制定相关决策至关重要。他们必须真实地呈现数据和见解,以确保人工智能计划与业务目标保持一致,并鼓励多个利益相关者进行协作。能够清晰简洁地解释人工智能和分析的好处和局限性也很重要。凭借扎实的沟通技巧,数据驱动的计划如果得到有效沟通,组织策略可以更容易实施并获得更高的成功率。

变革管理

变更管理对于采用新流程和技术的员工和其他利益相关者至关重要。它也是减少组织员工对变革的抵制和确保整个组织接受数据驱动型计划的关键工具。因此,拥有变革管理技能,有效地向员工传达人工智能和人力资源分析的好处,将帮助他们适应和接受这些新流程和技术。

战略思维

最后,为了真正利用人工智能,人力资源领导者应该能够战略性地思考如何使用人工智能和人员分析来推动业务成果,例如提高员工保留率、招聘偏见、提高生产力或降低成本。

他们还应该意识到人工智能数据驱动的计划可能产生的道德问题,例如员工隐私问题。制定适当的策略以最大程度地降低数据泄露或滥用的风险也很重要。

利用人工智能增强人员分析

通过利用他们的技术、分析、沟通、变革管理和战略思维技能。人力资源主管可以确保人工智能可以帮助推动他们的人员分析计划。例如

人工智能可以帮助人力资源领导者识别数据收集中的模式和趋势,而人类分析师可能不会立即意识到这些模式和趋势。它还可以帮助自动化日常任务,使人力资源人员能够专注于更具战略性的工作。

人工智能可以通过筛选简历并根据候选人的技能和资格而不是人口统计特征来识别候选人,从而帮助减少招聘过程中的偏见。它可以通过提供各种数据驱动的工具和平台来增强员工的学习体验。

但总而言之,使用可信赖人工智能需要五大支柱:

第一是透明度。比如说,当你去你最喜欢的咖啡店买饮料时,你会看到营养标签。你看它有多少卡路里。人工智能是怎么回事?人工智能有什么帮助?我们应该能够以用户的身份深入研究它,而不仅仅是作为数据科学家,而是作为人工智能的用户。

第二是可解释性。为什么人工智能给我这个建议?当你看电影时,它会对你喜欢的电影类型、其他观众在看什么以及为什么人工智能给你推荐电影有一定的了解。人力资源中的人工智能也应该让你对背后的原因有同样的了解。作为用户,我们应该能够理解人工智能给出相关建议背后的原因。

第三是公平。这都是关于偏见识别和缓解的。因此,作为AI设计不可避免一部分,用户要预先想到这些事情。

第四是稳健性。使用人工智能应该拥有正确的指导方针和操作原则。

第五是隐私。这是我们一直在实践的事情,但在该领域增加法规的领域变得更加重要。

数据驱动型决策

总体而言,人工智能具有改变人力资源和人员分析的潜力,但它需要熟练的领导才能充分发挥其潜力。人力资源领导者应具备数据管理、技术和分析技能,以制定数据驱动的计划,并产生可衡量的结果。

文章来源:Myhrfuture.com

隐私

【众合云科】警惕隐私被“扒”,离职前一定要删除的文件曝光,太真实了

最近,关于“离职前一定要删除的文件”的话题引发热议。

评论区有位网友留言:“本人是做IT工作的,公司曾经fire某位高管,让我接手清理电脑,第一件事就是复制所有的文件到移动硬盘,完成后直接锁进保险柜。那些可都是私人文件,心里五味杂陈,同为打工人,何必为难别人?”一语道破打工人的无奈和心酸。职场本就没有不散的宴席,离职也是人之常态,但有的离开难免会出现磕绊,保护好自己的隐私,已成为打工的最后体面。那么,在离职前,我们该如何保护好自己的隐私呢?我们使用的电脑隐私真的清理干净了吗?

离职前电脑隐私清理

打工人的最后体面朋友小曾在某上市公司工作了近八年,是证券事务部的管理骨干。他工作责任心极高,且专业知识扎实,领导安排的任务都能不打折扣地完成,为此深得领导喜欢。许是受外部经济环境的影响,公司的现金流出了问题,员工工资已经拖了三个月没发。小曾的父亲得了重病,一直在住院治疗,每月光医疗费都需要不少钱,他只能跟周边的朋友借钱维持,最后无奈提出离职。没想到,在他提出离职后,领导多次挽留无果,就翻了脸。专门找到IT部门的同事,趁小曾不在位置上,拷贝出他的微信聊天记录,并以此威胁小曾延后离职日期。身在职场,微信已经成为我们必备的沟通工具。除了平时工作交流外,偶尔也会聊聊八卦,甚至成为我们吐槽领导和同事的树洞,存放了太多的负面情绪。信息一旦外泄,后果难以想象。俗话说:“防人之心不可无。”职场环境本就鱼龙混杂,有的人敦厚善良,有的人为达目的不择手段,甚至失去底线,小心才能驶得万年船。在我们提出离职时,职场关系就已经发生了微妙的变化,保护好自己的隐私已是刻不容缓。离职前,及时对电脑隐私清理,不落把柄在他人手里,俨然已经成为打工人的最后体面。

电脑清理有技巧

清理尺度要把牢俗话说:“铁打的营盘流水的兵。”离职本应该好聚好散,但世上总有些事会留有遗憾,若你带着几分怨怼和憎恨去处理离职事宜,在电脑清理时很容易越过界,一不小心掉进“坑”里。在上海某贸易公司工作的冯女士,担任营业部助理工作。工作兢兢业业,各方面表现优秀,公司选择跟她签订了无固定期限劳动合同。后来,公司为了降低经营成本,制定了人员优化策略,而冯女士不幸成为被裁的对象。在协议离职环节,双方谈判得并不顺利。冯女士心里觉得很是憋屈,在离职前对工作电脑进行清理,不但对个人隐私资料做了删除,还对存储在电脑里的工作文件也做了清理,如公司证照、对账单、客户联系方式等。这对公司的经营产生了一定的负面影响,弄到双方对簿公堂,两败俱伤,最后冯女士还得承担公司恢复电脑硬盘的费用。结束,是新的开始。当我们决定离开的那一刻,尽可能所做的事情,都要与美好的未来有关。在清理电脑时,要把握好尺度,不去清理与公司和工作相关的资料,以免惹上不必要的麻烦;同时,务必连心一起清空,对曾经的过往,既不怨恨,也不留恋。

关于电脑隐私清理

职场“老司机”这样做1、微信聊天记录清理前不久,我离开了工作近十年的公司,基于HR职业的敏感度,还专门上网找了一份“离职电脑清理攻略”,认真地研究了一番。不得不说,电脑隐私清理,真的很有技巧,其中最重要的就是微信聊天记录的清理。毕竟我们平时工作都是用电脑登录微信,手机的消息也会一并同步保存在电脑上,如果不仔细清理,隐私就等于直接暴露给他人。微信聊天记录都保存在WeChat Files文件夹里,可以从电脑文档进入这个文件夹,直接删除就可以。操作方法:首先打开电脑版微信,点击左下角设置;然后点开文件管理,打开文件夹,找到聊天存储文件FileStorage,将里面的所有文件删除;最后建议删除接收的视频、图片、文件,相对应的名称分别为video、Image、File。2、电脑使用记录清理对于喜欢工作中浑水摸鱼的人,电脑使用记录清理就很有必要,否则在电脑归还时,很容易就给相关监管部门留下摸鱼的证据。清理方法比较简单,打开Win10自带的搜索面板,下方的“最近活动”会显示我们最近打开的文件、视频、图片等文件。操作方法:先打开“系统设置”,找到隐私,点击“活动历史记录”;取消勾选“在此设备上存储我的活动历史记录”;点击页面底部“清除”按钮,就能完全清除之前存储的历史记录。3、软件缓存清理有人会说,清理电脑这么麻烦,那我直接把相关软件卸载就可以了!这不过是“一叶障目”的做法。因为就算你卸载了软件,记录也会留存在电脑上。如果想要彻底地清除缓存,不如试试这个办法。操作方法:先用鼠标右键点击需要清理的软件,点击“打开文件所在位置”;只需要把整个文件夹拉进回收站删除,最后清空回收站就可以了。还有人说:“搞这么麻烦,直接将电脑硬盘格式化就可以了。”这确实是最简单的办法,但也是风险最大的办法。毕竟硬盘格式化会将公司和工作的文件同时清理,这种操作很容易惹上麻烦,实属没有必要。离职一旦浮出水面,不管是自愿还是非自愿,我们都希望可以全身而退。花点时间清理工作电脑,则是跟过去告别的最后体面。最后对于HR,51酱想说的是,HR作为员工与企业间的纽带,维系着双边的关系、同步着两边的需求与内容,是非常重要的角色,HR一定要提高自己的情商,多站在公司的角度、合规合法处理问题。离职也是每个员工和每个企业都会遇到的,不管过程怎么样,愿我们在离职时,都能够优雅地跟过去说再见。*本文授权转载自智联招聘,有部分删改

关于51社保众合云科旗下51社保是技术驱动的专业雇主服务商,以101HR科技平台为基础,构建覆盖全国 130+ 城市的全直营客户支持网络,为企业提供一站式互联网人力资源共享服务。101HR是新一代企业薪酬福利SaaS平台,包含五险一金标准化、薪酬标准化、外包与派遣、商保与福利等管理模块,为企业带来高效、便捷、稳定的人力资源服务。

隐私

HRTech高管必读:当下数字化时代,不断变化的世界中的信任

Workday的首席法律官兼企业事务主管Rich Sauer介绍了workday如何定义信任,为什么它在当今不断变化的工作世界中很重要,以及它对我们业务的影响。

信任对我们每个人都意味着不同的东西,但鉴于过去两年的事件,我们已经亲眼看到它的力量和价值是如何普遍地不可否认的。它可以在有分歧的地方建立共识,在有距离的地方建立社区,在有不确定性的地方建立前进的道路。

在Workday,信任是连接我们和我们的员工,我们的客户,以及我们整个社区的结构。我们认识到,信任不是假定的,而是赢得的,我们不懈地努力,在我们的每一次对话,每一个立场,以及每一个产品的开发中赢得和保持信任。

一句话,信任是我们所做一切的核心。它指导我们为我们的员工、客户和社区做正确的事情。它促进了更大的合作和透明度,使我们能够通过创新解决挑战。它激励我们为建设一个以信任为基础的世界尽一份力。

对我们关系的信任 Trust in Our Relationships

在Workday,员工是我们的首要核心价值,我们认识到他们的需求是多样的、复杂的和不断变化的。我们通过把他们放在第一位,照顾他们的需求,并为他们提供丰富的和有吸引力的经验,其中穿插着健康的乐趣,来与我们的员工建立信任。

我们如何做到这一点的一个例子是,我们在新冠疫情期间努力支持员工。我们的目标是在他们需要的时候满足他们的需要,无论是通过一次性付款--相当于两周的工资--来帮助解决任何不可预见的费用,扩大我们的照顾者支持,提供免费的心理健康资源,还是推出新的灵活的时间表,包括 "感谢 "星期五--让整个公司断开联系并对在困难情况下的努力工作表示感谢。通过这些努力,我们的目标是做正确的事情,坚持我们的价值观和我们作为一个公司的立场。

Workday明白我们必须在帮助建立一个以信任为基础的世界中扮演的角色。

此外,我们通过培养强大的员工体验来与我们的员工建立信任,这种体验始于持续的、双向的对话,以了解员工的需求并作出相应的回应。我们的目标是倾听并不断与我们的员工接触,为所有人建立一个伟大的工作场所,并每天努力赢得并保持他们对我们的信任--无论是通过使用我们自己的产品,如Workday Peakon Employee Voice,还是通过我们自己的工作场所举措,如提供专注于信任概念的学习之旅。

信任也是我们客户关系的基础。我们的客户相信我们可以帮助他们驾驭变化,而我们每天都会出现,以支持他们的需求。过去两年的事件证明了这一事实,因为我们帮助我们的客户和他们的员工--其中许多人在前线--引导大流行病及其对他们业务的震荡影响。我们为我们能够在这些关键时刻满足客户的需求而感到自豪;然而,我们认识到他们对我们的信任远不止于此。在变革时期,他们依靠我们倾听他们的需求,诚信地进行创新,并提供他们所依赖的解决方案,以帮助他们在不断变化的工作世界中航行,同时保持他们的数据安全和可靠。

对创新的信任 Trust in Innovation

当涉及到创新时,我们将信任放在首位。我们的客户期望我们创造和提供诚信的产品,正因为如此,隐私、道德和安全从第一天起就被嵌入到Workday的设计中。

我们专注于在Workday服务的所有方面提供无与伦比的安全和数据隐私。这包括遵守和帮助我们的客户遵守各种国际隐私法规,坚持我们的隐私设计原则。事实上,Workday的运营、政策和程序都会被定期审计,以确保我们始终满足或超过一个云服务提供商的所有预期标准。此外,通过提供一个一致的安全模型,采用行业领先的保护措施,并不断监测我们的服务,我们的客户可以放心,我们优先保护他们的数据。

我们的客户也相信我们能够提供可靠的创新,这就是为什么我们在如何支持他们的产品部署方面进行了大量投资--将安全功能、检查和平衡以及测试纳入我们的方法--目的是提供他们需要的功能、可见性和透明度,以及最高标准的可靠性和可用性。当我们更新我们的软件时,我们同时向每个Workday客户提供,这简化了使用和支持,并使我们的客户能够通过我们的Workday社区分享他们的经验,在那里他们可以联系到最佳实践和学习,向我们提供反馈,等等。

我们客户的另一个重要期望是在他们需要的时候获得他们需要的服务。为了保持服务的可用性,我们的架构能够扩展,以满足客户不断变化的工作负载需求,并且我们在主动监测方面进行持续投资,以便在客户受到影响之前确定问题并应用计算和网络资源。正是因为这些努力,本财年迄今为止,我们的服务可用性正常时间为99.97%,而且我们能够保持97%的客户满意度。对我们来说,信任是建立在履行我们的承诺之上的。

对我们周围世界的信任Trust in the World Around Us

Workday明白我们在帮助建立一个以信任为基础的世界方面必须发挥的作用。我们通过促进前瞻性公共政策的发展和支持植根于透明度、道德商业惯例和支持可持续发展的倡议来做到这一点。

除了在我们提供的产品中对隐私的承诺外,我们相信隐私是一项基本权利。我们是企业云计算领域的领导者,并与政策制定者进行建设性的合作,以推进现代法律框架,保护个人并加强世界各地对技术的理解和信任。此外,我们是第一个遵守最近发布的GDPR下的欧洲云行为准则的云供应商。

除了负责任的创新和隐私领域,我们还认识到我们在世界中的地位以及人们对我们的信任,以帮助确保其未来得到保护。这也是我们对环境可持续发展承诺的基石,我们认识到需要迅速采取有意义的行动来应对气候变化。Workday致力于尽我们的努力,帮助世界在2050年之前实现一个净零的未来,将全球变暖控制在比工业化前水平高1.5°C,我们支持像《巴黎协定》这样的政策,可以帮助我们实现这一目标。Workday致力于清洁和可再生能源,在2020年,我们在全球范围内的办公室和数据中心的用电100%采用清洁、可再生资源。

信任和我们的前进道路 Trust and Our Path Forward

在我们前进的过程中,我们牢记这些原则,以便我们建立的每一种关系,我们的每一个想法,以及我们采取的每一个行动,都有助于加强在一个不断变化的世界中把我们所有人联系在一起的结构--信任。

隐私

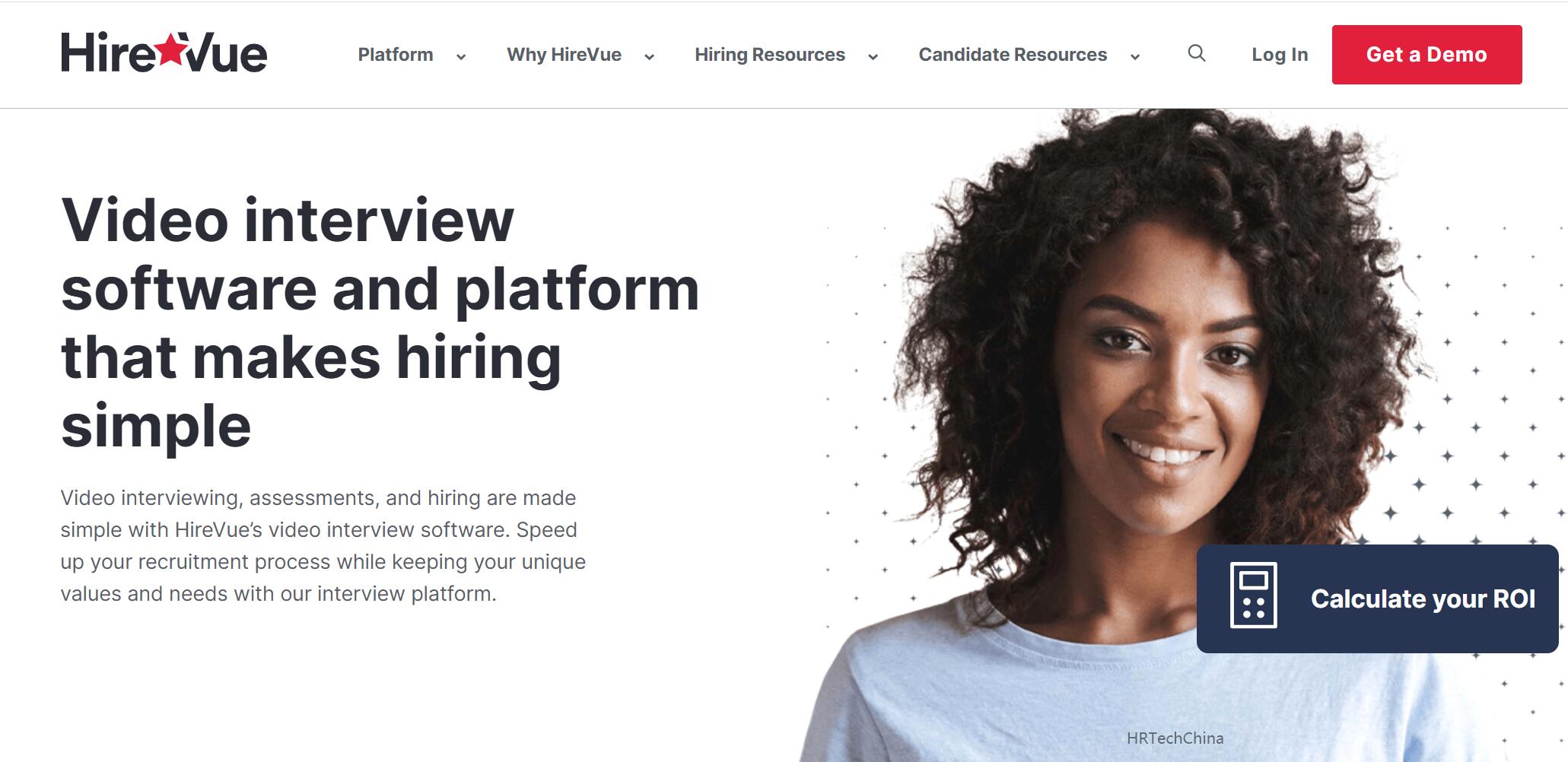

微表情分析不能做了?—知名AI视频面试公司HireVue停止视频面试中对面部表情分析服务

编者注:这是一个趋势,尤其是面对个人生物隐私问题的时候。HR科技公司在这方面需要有更全面的考虑和前瞻性的眼光。

对此你怎么看?

现在的求职者可能不仅需要打动潜在的领导,还需要打动人工智能算法,因为雇主通过让候选人回答视频中的面试问题来筛选候选人,然后由机器对其进行评估。

一家领先的软件提供商HireVue基于算法评估来审查求职者。该公司表示,正在取消其软件的一个有争议的功能:分析视频中人的面部表情以识别求职者某些特征。HireVue筛选的求职者坐在网络摄像头前,回答问题。他们的行为,语调和言语被反馈到指定某些特征和品质的算法中。

HireVue说,去年对其软件进行的“算法审核”显示,它没有偏见。但非营利组织电子隐私信息中心已于2019年向联邦贸易委员会投诉该公司。

HireVue首席执行官凯文·帕克(Kevin Parker)承认,公众对于使用软件分析视频中的面部表情的强烈抗议是计算的一部分。他说:“这为客户增加了一些价值,但不值得关注。”

算法审计由外部公司O'Neil风险咨询和算法审计进行。该公司没有回应置评请求。

布鲁金斯学会(Brookings Institution)的一位研究AI聘用的研究员Alex Engler说,使用AI来确定某人的能力(无论是基于视频,音频还是文本)的想法是牵强的。他说,公众不能审查这种算法也是有问题的。

他说:“机器学习可能对某些部分有帮助,但是全自动面试会给你关于工作表现的推论,这太糟糕了,”他说。“现代人工智能无法做出这些推断。”

“完全自动化的面试,您在其中推断工作绩效,这太糟糕了。”——布鲁金斯学会研究员亚历克斯·恩格勒

HireVue说,大约有700家公司,包括GE,联合利华,三角洲和希尔顿,都在使用其技术。该软件要求求职者在录制的视频中回答一系列问题。然后,该公司的软件会分析各种特征,包括他们使用的语言,他们的语音以及直到现在的面部表情。然后,它评估了申请人对工作的适合程度,并评估了包括“依赖性”,“情绪智力”和“认知能力”在内的一些特征。

帕克说,该公司去年帮助筛选了超过600万个视频,尽管有时这只是为候选人的面试回答抄录答案,而不是对候选人进行自动评估。他补充说,有些客户让求职者选择退出自动筛选。他说,HireVue已经开发出了一些方法,可以避免因参差不齐的互联网连接而对候选人造成惩罚,并自动将候选人推荐给HR。

AI专家警告说,对以前求职者的数据进行训练的算法可能会使招聘中的现有偏见长期存在。HireVue的首席数据科学家Lindsey Zuloaga表示,该公司通过在培训数据中收集该信息并寻找偏见的迹象来筛选性别,种族和年龄方面的偏见。

但是她承认,要知道该系统是否因收入或教育水平等因素而受到偏见,或者是否受到诸如口吃之类的因素的影响,可能会更加困难。

EPIC高级顾问约翰·戴维森(John Davisson)说:“令我惊讶的是,他们放弃了这一功能,因为这是他们所营销产品的关键特征。” “这引起了对生物识别数据收集的许多关注,以及这些关于能够测量心理特征,情绪智力,社会态度以及类似事物的大胆主张。”

使用面部分析来确定情绪或人格特质是有争议的;一些专家警告说,基础科学有缺陷。

东北大学教授丽莎·费尔德曼·巴雷特(Lisa Feldman Barrett)研究情感分析,他说一个人的脸不会自己露出情感或性格。她说:“仅仅看着一个微笑的人,就不能真正告诉他们任何东西,除非他们的牙齿很美。” “进行心理推断,从而仅根据面部数据来确定人们的结局,是一个坏主意。”

EPIC的FTC投诉指控HireVue无法保证公平,并使用了无法审查的算法。它还指控该公司声称不使用面部识别,从而歪曲了其技术。戴维森说,该机构尚未对投诉采取行动。

但是戴维森说,他担心语音的自动分析仍然会存在问题,他说,公司发布算法审核的结果很重要。他说,HireVue的技术仍然需要彻底审查。

“我当然担心,围绕数据收集,偏见和不透明度的相同潜在问题会直接转移到基于音频的放映系统中。“

人工智能的招聘引起了一些监管机构的注意。纽约市议会提出的一项法案提议规范招聘软件的使用,要求雇主在AI评估候选人时通知他们,并要求他们每年审核其算法。

伊利诺伊州的法律要求候选人同意才能对视频片段进行分析。马里兰州已禁止使用面部分析。据报道,由于结果偏颇,亚马逊在2018年放弃了使用自己的技术来自动评估候选简历。

背景信息:

视频采访和雇用前评估的提供商HireVue上周宣布,它在2020年初取消了其软件的视觉或面部分析组件。

该公司表示:“ HireVue的内部研究表明,自然语言处理的最新进展显着提高了语言的预测能力。” “随着这些进步,视觉分析不再显着增加评估价值。”

《连线》杂志报道了该功能,该功能可分析一个人的面部表情,一直存在争议。

在上周的公告中,该公司引用的数据表明言语和非言语行为是一致的,非言语数据并没有对其预测算法增加太多。另一方面,该公司指出,非言语行为的确为某些角色增加了额外的理解,例如,高度互动的角色重视镇静的语调或举止。

此外,HireVue上周还宣布,由O'Neil Risk Consulting和Algorithmic Auditing进行的算法审计发现,HireVue的评估工作存在如公平和偏见问题。

去年10月,HireVue收购了AI驱动的招聘聊天机器人AllyO。

作者:Will Knight

对此你有什么看法?

隐私

Slack、Zoom、谷歌环聊:你的远程工作应用在监视你吗?

编者按:因为COVID-19,越来越多的员工被迫在家工作,而像Zoom、Slack这样方便在线办公的应用在全球用户数和流量也呈几何级数激增。但是,许多人没有意识到这些应用背后暗藏着很多隐私安全问题,有些甚至超出了寻常认知。本文梳理了一部分这些应用存在的问题,以提醒读者,以后线上办公可要小心啦。文章译自Medium,作者Yael Grauer,原标题Slack, Zoom, Google Hangouts: Are Your Remote Work Apps Spying on You?

图片来源:Unsplash

为了应对Covid-19,许多公司已经允许甚至要求员工开始远程工作。这意味着,员工可以在工作中不落于人后的情况下进行社会隔离,同时还能领到薪水。

众所周知,通过Slack、Zoom和谷歌环聊(Google Hangouts)等工具与同事、管理人员联系与在办公室联系是不一样的。但技术故障并不是唯一令人担忧的问题,因为会议已被简化为一个个字节。用户隐私也是。

“随着我们将更多的日常生活转移到这些平台上,我们将看到新的、不同的、甚至可能更大的隐私风险,比如企业监控和雇主监控。”领先的非营利性数字版权组织电子前沿基金会(Electronic Frontier Foundation,EFF)的副主任吉尼·格哈特(Gennie Gebhart)说道。

现在的情况转变成,当员工在家工作时,整天使用这些工具,这可能会给一些雇主一个查看员工在做什么的新机会。你应该意识到,根据公司使用的软件和现有的政策,可能存在一些隐私问题。

你的老板也许能读到你的Slack私信

很多人已经在工作中使用了Slack,但如果每个人都在家里工作,那么很自然就会把本来要面对面进行的“茶水间谈话”转移到平台上。这并不总能奏效。

“在公司Slack里的许多员工可能不知道,你发给其他用户的私信虽然看起来很私密,但对你的老板和人力资源部门来说,这些私信与你在渠道中发给其他用户的任何东西都一样可见。” 新美洲(一家专注于技术和媒体的智囊团)的网络安全政策研究员塔拉·惠勒(Tarah Wheeler)说。

“企业导出所有消息”只适用于付费Plus或Enterprise Grid账户的组织,而不是免费或标准帐户,而且Slack指出,工作空间所有者需要有相应的就业协议和企业政策才能使用该功能。此外,公司还必须遵守所有相应法律。即便如此,私人聊天也只是提供了一种隐私的伪装。(注:Enterprise Grid提供大型企业协作通讯架构,足以支持5000至50万名雇员规模的企业。)

格哈特建议说:“如果你不想在全员会议上弄得人尽皆知,就不要放松,即使是发私信也不行。”

你可以通过官网查看Slack群组的团队设置,弄清管理员是谁,还有你的群组应用了哪些保留原则和导出设置(包括是否打开消息导出),以及你的公共和私人通道、私信和文件的保留设置。

注意Zoom中的屏幕共享

虽然你可能会希望主持人在面对面会议时注意到你向下看了一分钟,但当你在自己舒适的家里视频聊天时,你可能不会有同样的想法。事实证明,Zoom有一个注意力跟踪功能,如果你把视线移开,它可以提醒主持人。

如果账户管理员启用了注意力跟踪功能,那么共享屏幕的会议主持人就可以(甚至需要)查看参与者的Zoom是否在30秒内失焦(在他们的屏幕上没有打开或活动)。但与会者却没有此通知功能。

“重要的是,该功能只有在Zoom视频窗口打开时才会跟踪。它不跟踪音频或视频内容的任何方面,也不会跟踪窗口上的任何其他应用程序。”Zoom公司的一位发言人在电子邮件中说。

“会议室”里发生了什么…

Zoom、Google和Slack等服务都有可接受的或合理的使用政策,这些都是为了确保你遵守关于共享版权材料、裸露画面和亲密活动等方面的规则。但这也意味着,除非你使用Zoom 的加密视频聊天功能,否则这些公司有能力知道你在他们的平台上做了什么。

耶鲁大学法学院讲师、耶鲁大学隐私实验室创始人肖恩·奥布莱恩(Sean O Brien)表示:“任何运营这些服务的人都可以在任何时候通过拨号进入房间,或查看存储的视频。”团队说他们这样做是为了提供技术和业务支持,以及改善他们的服务,但是他们可以偷听这一点仍然引人深思。奥布莱恩说:“这里面有一个令人毛骨悚然的因素,正如我们过去看到的(其他拥有类似能力的公司),有很多员工行为不端。”例如,在2018年,一名Facebook工程师利用自己有权访问的数据来跟踪女性。还有,在2019年,Snapchat的员工通过一个名为SnapLion的内部工具监视用户。

Slack保留着数据——即使你看不到它

免费的Slack工作区不允许工作区所有者设置数据保留限制,它们还将可见性限制在仅一万条消息之内,这就要求用户只有付费才能看到超过这一限制的消息。但是,不能访问你以前的信息并不意味着它们永远消失了。

“我认为很多人可能无法立即理解的是Slack仍然保留着那些旧信息,” 格哈特说。“你无法删除或编辑它们,但它们仍在Slack服务器上存在着。”

Slack可以访问你无法访问的内容,也可以接受执法部门的要求进行访问,也容易受到黑客攻击或信息泄露的影响。“使用免费账户的人无法控制自己数据的保留情况,完全听凭Slack摆布。”她补充。

信息泄漏

默认情况下,Slack会打开电子邮件通知功能,这意味着除非你修改了通知设置,否则邮件和@你的回复可能会进入你的收件箱。

格哈特说:“对于一些人来说,这可能有些令人不快,尤其是如果他们注册了个人邮箱的话。”实际上,这意味着即使你从Slack上删除了信息,你仍然可以通过收件箱访问它们。

谷歌的环聊则需要使用谷歌帐户(无论你是使用特定的Gmail地址还是将另一个电子邮件地址链接到你的帐户)。这可能导致人们会使用他们个人的Gmail地址(而不是他们的工作帐户)来发起聊天,而向同事显示了个人电子邮件地址则可能会泄露你希望保密的信息。

除此之外,拥有相同电话号码或邮箱地址的不同在线账户也可能会以意想不到的方式串在一起,将你活动的不同方面连接到一个单一身份之中。格哈特说:“你可以想象工会组织活动,各种激进主义,性工作,所有这些都可能在你意料之外连接到账户而被意外曝光。”

谷歌发言人指出,环聊的服务页面提供了关于如何在设备中存储信息以及如何更改这些设置的详细信息。但请记住,你这一系列谷歌产品的管理员都在控制着你工作空间中的这些设置。

译者:Yoyo_J 神译局是36氪旗下编译团队,关注科技、商业、职场、生活等领域,重点介绍国外的新技术、新观点、新风向。

隐私

LinkedIn阐明了其信任的四项原则 专业网络讨论用户数据,安全性,机会均等和法律

社交网络领域中非专业方面的信任 已成为最近几个月的热门话题,因此,针对专业人士的网络LinkedIn试图阐明指导其努力保护其成员并保持其信任的原则。

高级副总裁兼法律总顾问布莱克·拉里特(Blake Lawit)在博客中写道:“随着我们对工作世界的影响越来越大,我们认识到责任也越来越大。我们了解,在隐私,安全性,安全性和公平性等关键领域中,我们需要继续为我们的会员和全世界提供服务。因此,除了首先获得会员的基本价值外,我们还使用一系列指导原则来确保我们的员工做出最佳决策,以保护我们的会员并维护他们的信任。”

Lawit概述的四项原则如下:

清晰,一致和对用户数据的控制: Lawit说,LinkedIn告诉其成员打算如何处理其数据,并且不会将这些数据用于其他目的,并补充说,专业网络的易于使用的设置为他们提供了完全的控制权。

安全: LinkedIn使用其成员的系统,技术和报告来检测并快速删除违反其社区政策的内容。Lawit还重申了专业网络对防止虚假个人资料,工作和公司的承诺。

机会均等: Lawit说,LinkedIn致力于在不偏不倚的前提下开发其产品,为所有成员提供机会并寻求缩小网络差距。

遵守法律: Lawit写道:“我们是一个全球平台,有义务尊重适用于我们的法律。我们还为塑造这些法律的对话做出了贡献,从而实现了为全球劳动力的每个成员创造经济机会的愿景。”

AI翻译原文如下:https://blog.linkedin.com/2019/november/1/maintaining-the-trust-of-our-members

在LinkedIn上,我们的核心价值观之一一直是将会员置于第一位。这意味着每天在做大小决定时,我们都会问:“这对我们的会员来说是正确的事情吗?” 这个价值是驱动我们,团结公司并推动我们继续值得我们近6.6亿会员信任的价值。

随着我们对工作世界的影响越来越大,我们认识到我们的责任也越来越大。我们了解,在隐私,安全性,安全性和公平性等关键领域中,我们需要继续为我们的会员和世界提供服务。因此,除了首先要重视会员的基本价值外,我们还使用一系列指导原则来确保员工做出最佳决策,以保护会员并维护他们的信任。

这些原则是:

我们为会员提供清晰,一致和对自己数据的控制。简单地说,我们告诉我们的会员我们将如何处理他们的数据。然后,我们按照我们所说的对数据进行处理。我们努力为我们的会员提供简单,易于理解的设置和控件,以使他们可以控制自己的数据。

我们致力于使LinkedIn成为一个安全,可信赖且专业的平台。因为我们重视专业表达,所以我们使用会员的系统,技术和报告来检测并迅速删除任何违反我们专业社区政策的内容。成员也理所当然地希望他们在LinkedIn上遇到的内容是合法的。这就是为什么 我们非常专注于删除虚假的个人资料,工作和公司的原因。

我们认为,两个具有同等才能的成员应享有平等的机会。为了实现这一目标,我们致力于构建一种不偏不倚的产品,为所有会员提供机会。仍有许多工作要做,但我们专注于跨公司,与成员和客户以及整个行业合作,以缩小网络差距。

最后,我们是一个全球平台,有义务尊重适用于我们的法律。我们还为塑造这些法律的对话做出了贡献,从而实现了为全球劳动力的每个成员创造经济机会的愿景。

我们的成员来LinkedIn找工作,保持了解情况并学习新技能。我们有责任为他们提供一个安全且可信赖的平台来做到这一点,并对我们如何决策以建立他们期望的专业社区持开放态度。

————————————————————————————

英文:

Here at LinkedIn, one of our core values has always been to put our members first. This means that every day, when making decisions large and small, we ask: "Is this the right thing to do for our members?" This value is what drives us, unites our company, and pushes us to remain worthy of the trust of our nearly 660 million members.

As our impact on the world of work has grown, we recognize that our responsibility has grown as well. We understand that in the critical areas of privacy, security, safety, and fairness, we need to continue to deliver for our members and the world beyond. So, in addition to this foundational value of members first, we use a set of guiding principles to ensure our employees make the best possible decisions to protect our members and maintain their trust.

These principles are:

We provide our members with clarity, consistency, and control over their data. Simply, we tell our members what we will do with their data. We then do what we say we will do with this data. And we strive to provide our members with simple, easy to understand settings and controls so that they are in control of their data.

We are focused on keeping LinkedIn a safe, trusted, and professional platform. Because we value professional expression, we use systems, technology, and reports from our members to detect and quickly remove any content that violates our Professional Community Policies. Members also rightfully expect content they encounter on LinkedIn to be legitimate. That’s why we are deeply focused on removing fake profiles, jobs, and companies.

We believe two members with equal talent should have equal access to opportunity. To achieve this goal, we are committed to building a product with no unfair bias that provides opportunity to all of our members. There is a lot of work still to do, but we are focused on working across our company, with our members and customers, and across the industry to close the network gap.

Finally, we’re a global platform with an obligation to respect the laws that apply to us. We also contribute to the dialogue that shapes these laws so that we can fulfill our vision of creating economic opportunity for every member of the global workforce.

Our members come to LinkedIn to find a job, stay informed, and learn new skills. It’s our responsibility to give them a safe and trusted platform to do just that, and be open about how we make decisions to build the professional community they expect.

隐私

长篇经典:人力资本分析和AI的四个信任的维度-Josh Bersin

编者注:这是一个长篇的文章,谈AI和People Analytics在工作场所中的几个核心的问题:信任的四个维度:隐私、安全、偏见、人的影响。值得思考!

尤其是HR开始新的数字化时代。请记住,信任是我们今天业务中最重要的事情之一。如果发生不好的事情,你不仅会失去工作,而且对公司声誉的损害可能是巨大的。

原标题:People Analytics and AI in the Workplace: Four Dimensions of Trust

作者:Josh Bersin

以下由AI翻译完成,仅供传递信息,原文请访问文末

AI和People Analytics已经很火了。正如我过去所写的,工作场所已成为一个高度数字化的地方。公司使用调查和反馈工具来获取我们的意见,新工具监控电子邮件和我们的通信网络(ONA),我们捕获有关旅行,位置和移动性的数据,组织现在拥有关于我们的健康,健康和健康的数据。

此外还增加了一个新的数据流,其中包括视频(每个视频会议都可以录制,超过40%的工作面试被录制),音频(记录会议的工具可以感知心情),以及识别面部的图像识别。

在人力资本分析的早期,公司捕获了员工数据,以衡量控制范围,绩效评级分布,继任管道和其他与人才相关的主题。今天,随着所有这些新信息进入工作场所(几乎在工作中点击的任何地方存储在某个地方),人员分析的领域变得非常个性化。

虽然我知道人力资源专业人员认真对待道德和安全工作,但我想指出一些我们需要考虑的道德问题。

数据滥用的风险

首先,让我给你一点动力。虽然您可能会从人力资源软件公司购买一个出色的新员工参与工具或“保留风险预测器”,但这些新系统会带来风险。当您购买系统时,您实际上不知道它是如何工作的,因此它所做出的每一个决定,建议或建议都会成为您组织的问题。

例如,假设您使用Pymetrics,HireVue(编者注:视频面试的工具)或其他高级评估技术来评估求职者。虽然这些供应商努力消除工具中的种族,性别和代际偏见,但如果您实施这些偏见并且候选人起诉您,您的公司应负责任。这种情况一直都在发生。(了解亚马逊如何无意中创建了自己的性别偏见的招聘系统。)

我就遇到过这种事情。多年前我们邀请一名秘书职位的候选人面试,但是我当天不得不离开办公室。候选人来到办公室,我们的办公室经理告诉她我们必须重新安排面试。她立即起诉我们歧视,因为她是受保护阶层的成员。我感觉很糟糕,我们付出了她的时间,但我能看出她的感受。

我要指出的另一个例子。一家公司从他们的HCM系统打开“保留预测器”告诉我,他们的经理看着这些评级,并在看到飞行风险时做各种奇怪的事情。一些管理人员实际上不再与这些人交谈并减少他们在工作中获得的支持,因为我猜他们认为“他们正在考虑离开。”显然,这不是良好的管理,但如果我们不好好利用这些数据,人们可以错误地使用它。

当然,还有其他可能出错的事情。如果您可以访问员工健康数据并使用它来评估或讨论员工的表现,我确信您处于合法危险之中。(我不是律师。)如果您泄漏或无意中发布了员工健康数据,则违反了HIPAA规则。

有很多很多地方可以解决问题。只要看看Facebook,Equifax,万豪以及其他所有认为他们都在保护数据的大公司的情况。人们犯错误; 员工做坏事; 我们必须保护数据,算法和管理行为。

随着人工智能变得越来越普遍,我们不再看到数据,而是看到“轻推”或“推荐”。如果“轻推”在某种程度上有偏见而员工变得心烦意乱怎么办?你知道这个软件是如何运作的吗?你可以回过头来确保它没有根据一些不正确的标准进行区分吗?

最后,如果您是分析师并且自己进行分析,您是否准备好在攻击下捍卫您的调查结果和建议?如果有人挑战您的发现并希望按年龄,性别,种族,甚至地点或季节了解数据 - 您是否已准备好确保其有效和可靠?我知道这是我们可以用统计工具做的事情,但我们必须要小心。

请记住,信任是我们今天业务中最重要的事情之一。如果发生不好的事情,你不仅会失去工作,而且对公司声誉的损害可能是巨大的。

我们应该做什么?

我在这个领域做了很多工作,包括花费相当多的时间与IBM,O'Reilly的人们,当然还要与许多人力资源领导者,人员分析领导者和供应商交谈。为了帮助您通过人员分析了解道德问题,让我提出以下框架。

首先,您使用的数据和算法是否公平?它是否准确反映了您想要的性能或生产率数据,而不排除,区分或无意中偏差结果?这很棘手,我将在下面讨论。从这个框架可以看出,道德有两个方面。

二,数据系统和算法安全吗?我们是否在保护隐私,机密性和安全性?谁有权访问,我们如何审核其在公司中的使用和路径?

这是IT中一个众所周知的问题,但现在我们必须处理人力资源问题。

当您查看这两个维度时,您基本上会发现有四个维度需要信任。

要考虑的第一个道德问题是隐私。如上图所示,Facebook,CVS,雅虎等公司在这里遇到了麻烦。当员工加入您的公司时,他们会授予您收集大量数据的权利,但我们作为雇主无权披露此数据,共享或将其与个人识别的信息相关联。

1.隐私

在GDPR规则中,如果员工要求,组织也必须“忘记”这些数据,因此需要考虑一些重要的业务实践。如果你看一下上面的一些问题,他们都会处理披露和保护问题。谁可以访问这些数据并让这些人接受过隐私规则和程序方面的培训?

在Deloitte,所有顾问都会参加强制性的隐私年度课程,我们的PC被扫描,我们接受培训,不会以可以披露的形式存储任何客户信息。就人力资源而言,我们需要告诉员工我们正在收集哪些数据,并确保他们理解这些数据是用于积极目的的。

虽然我们中的许多人可能会觉得在社交媒体和其他地方分享我们的个人故事很舒服(我个人不这样做),但其他人则更加私密 - 因此即使是内部员工目录也可能存在问题。一家大型科技公司最近告诉我一个关于工程师的故事,该工程师创建了一个内部社交网络,该网络显示了曾在哪个办公室工作的员工以及他们过去的工作。员工们很不高兴“发现”这个网站,因为他们没有事先征求意见,抗议其使用。该员工只是一名试图让公司成为更好工作场所的工程师,不得不关闭系统。

并且捕获的数据量不断增加。例如,L&D中增长最快的领域之一是虚拟现实(现在称为沉浸式学习)。VR程序捕获所有类型的个人表现数据 - 您的注意力范围,眼球运动以及您应对压力的能力。Pymetrics评估测量您的冒险能力和认知处理。这种类型的数据可能对目的有用(培训,工作适合),但如果不保密,也可能被滥用。

告诉别人您正在做什么,解释您的“选择加入”政策,并确保您为所有员工数据制定了良好的隐私政策。(GDPR规则要求您获得此类同意,并且您还允许员工查看您收集的数据。)

2.安全

隐私的姐妹是安全。数据是否存储和保护在其他人无法找到的地方?您是否拥有密码策略,加密和其他数据保护措施,以便员工无法将数据带回家,将其发送给第三方或意外将其发布到互联网上?这些是所有公司必须处理的IT问题,当我们收到诸如薪资,工作经历,医疗保健数据和其他个人信息等敏感信息时,我们必须妥善保护。

在欧盟,这已成为一项法律。GDPR规则之一是需要创建数据保护官并设计您的系统以进行数据保护。如果发现贵公司在这些地区失效,您可能会被罚款高达收入的2%,这是一个巨大的风险。

3.偏见

我们在People Analytics中遇到的第三个也是最困难的(也是最新的)问题是偏见。无论您是自己分析数据还是从供应商处购买AI工具,我们都必须记住所有算法系统都基于现有数据。如果现有数据存在偏差,则预测和建议将存在偏差。

这是一个非常难以解决的问题,许多组织正在努力解决这个问题。(IBM Research有关于此主题的精彩视频。)例如:

试图评估公平薪酬的系统会将员工与同行进行比较,但可能无法理解种族,地点和年龄等问题

预测保留的系统可能会歧视少数群体或因文化原因离开公司的其他人

评估适合工作的系统可能会使嵌入招聘历史的旧的,有鉴别力的招聘实践制度化

使用组织网络分析来识别绩效的系统可能没有意识到性别或年龄在信任和关系中起着重要作用

预测表现优异者的系统将偏向现有的高评价个人(可能是白人)。

您购买或构建的每个预测分析系统都会内置偏见。(“偏见”一词的意思是“基于过去的影响”,这正是AI试图做的事情。)

您可以采取的减少偏见的最佳方法是监控和培训您的分析系统。换句话说,查看它所做的预测和建议,并检查结果是否有偏差。亚马逊发现其招聘机器人偏向于女性。IBM通过“机器人培训师”不断监控其内部薪酬推荐引擎和在线管理教练(均由Watson提供支持),他们不断调整系统以应对新情况。

我记得几年前一家公司告诉我,中国的薪酬政策效果不佳,中国的工资增幅是美国的两倍。您的系统可能不知道这一点,因此它可能会偏向于中国的加薪或过度偏向美国的加息。这些不一定是不道德的决定,但这种偏见会伤害你的公司。

供应商非常关注这一点。Pymetrics对此非常认真,公司现在开放其算法来减少偏见。其他供应商应该这样做。

当我们巧妙地训练历史数据的算法时,我们在很大程度上只是重复过去。......我们需要做更多,这意味着检查数据中嵌入的偏见。 - 凯茜奥尼尔,“数学毁灭武器”

你能做什么?监控,评估和培训您的数据驱动系统。例如,IBM率先使用人工智能来帮助改善职业发展,管理实践和薪酬。该公司定期审查其基于Watson的人力资源预测员,并培训他们更聪明,更少偏见。(IBM告诉我,他们基于AI的人力资源聊天机器人现在可以在问题答案中提供超过96%的员工满意度。)

可解释,透明或可信的AI

人工智能社区有一个重大的变化,就是让系统“可以解释”。例如,为什么系统会推荐这个工资变化呢?如果您了解预测的原因,您可以更智能地对其进行操作。

4.人的影响力许多供应商正在构建检测AI偏差的工具,包括IBM的偏差检测云服务,来自Pymetrics的Audit AI。麻省理工学院的研究人员现在发布了自动偏置检测 以及 消除AI偏差而不会降低精度的方法。作为人力资源系统的买家,您应该询问这些功能。

信任的第四个维度可能是最重要的。您对捕获此数据的意图是什么?

正如GDPR规则 明确指出的那样,捕获数据以“看看它可能告诉我们什么”是不行的。如果员工认为他们因错误的原因受到监控,那么影响将是负面的。因此,我相信您应该坐下来记录为什么要捕获给定的数据流并清楚地为项目设定目标。Facebook显然没有在他们的业务中做到这一点,他们仍然在恢复声誉受损。

要问的最大问题是:为什么要实施这种特定的分析或AI工具?它会帮助人吗?还是用于监控或秘密进行绩效评估?

大多数供应商都有最好的意图。

Phenom People的新人才体验平台使用AI帮助求职者找到合适的职位空缺,帮助内部求职者找到合适的工作,并帮助聊天机器人向您提出智能问题,以了解您的工作需求。

Glint的新经理Concierge使用AI推荐行为变化和课程,以帮助您成为更好的领导者。ADP的Compass工具和CultureAmp的Zugata也是如此。Humu正在为团队和运营绩效做这件事。

来自IBM的Watson Candidate Assistant使用您的简历来确定您作为求职者的技能,并找到最佳工作,大大提高招聘质量和聘用时间。

EdCast,Valamis,Fuse和Volley正在使用AI推荐学习内容,BetterUp使用AI为您找到最好的教练。

Oracle,Workday和SuccessFactors使用AI来实现许多功能。Oracle HCM建议调整工资,甚至根据您自己的角色和行为自定义您看到的屏幕,从而简化系统本身。

像Spring Health这样的供应商现在使用AI来诊断您的心理健康并推荐正确的提示,辅导员或医生。

事实上,我很清楚所有人力资源技术供应商都在推动人工智能对人们的积极影响。然而,作为买家,我们必须确保我们能够很好地使用它。

举个例子,这里有一些要避免的事情:

不要使用监控数据秘密通知绩效评估。例如,一家金融服务公司使用一种热量和运动检测器来确定谁进入办公室。雅虎着名审查了VPN日志,以了解人们何时在家工作以及何时没有人工作。这类活动会损害员工的信任感,几乎总会导致糟糕的决策。

不得将任何形式的福利数据用于法律允许的任何其他目的。将某些健康数据用于保险定价是合法的:将其用于继任计划,绩效评估或任何其他形式的员工辅导是不合适的。

不要将训练数据(程序性能)用于性能评估。这不仅会降低信任度,还会使您陷入法律危险之中。

不要跨越个人和专业数据之间的界限。如果您正在跟踪员工手机中的数据,请确保您不会授予他人访问个人信息的权限。虽然该设备可能归公司所有,但侵犯隐私会让您陷入困境。

事实上,在大多数大公司中,在开始捕获数据之前应该进行法律审查。您的项目是否符合GDPR指南,HIPAA规则和其他机密性保护?

还要记住,基于AI的调度和工作供应问题也是有风险的工具。例如,万豪公司实施了一个新的系统来安排管家,并结束工会劳资纠纷,因为工人受到不公平对待。该系统正在推动管家疯狂地从一个房间跑到另一个房间。换句话说,它不是为了“帮助人们”,而是为了“帮助公司”。

我可以给出的简单建议是:将您的分析程序专注于对人产生积极影响的策略。如果您正在跟踪人员以衡量工作效率,并且数据将用于改善工作,那么您就会朝着正确的方向前进。如果您使用这些数据来淘汰低绩效企业,那么您可能违反了公司的管理原则。

底线:使用良好的意识,考虑道德是一个“安全”问题

越来越多的公司聘请了“ 首席道德官 ”和其他工作人员来帮助完成这些项目。其他人正在创建“道德使用委员会”,以确保所有分析项目都经过仔细评估。所有这些都是重要的想法。

就像多样性和包容性更像是“安全计划”而不是“培训问题”,数据的道德使用也是如此。最多元化的组织使用指标和委员会来确保他们的D&I战略得到加强。我们必须在道德使用员工数据方面做同样的事情。

当您启动新的分析程序时,您需要一份需要考虑的问题清单。问问自己“如果这个节目出现在纽约时报的头版上会怎么样?”这会损害公司的声誉吗?

如果答案是肯定的,你需要做更多的功课。

最后,让我们以数据为导向使用消费者体验。暴露大量消费者数据的公司遭受了可怕的打击。

今天,信任是我们拥有的最重要的商业资产之一。认真对待并确保您努力使管理数据驱动朝着正确的方向发展。你会很高兴的。

原文来自:https://joshbersin.com/2019/05/the-ethics-of-ai-and-people-analytics-four-dimensions-of-trust/

再次说明,翻译来自AI,仅供参考学习~

隐私

消息:谷歌向涉嫌年龄歧视的求职者支付了1100万美元

图片来源:HRTechChina

谷歌已经解决了一项指控其招聘行为中存在年龄歧视的诉讼,向申请加入该公司的200多名求职者支付了1100万美元。

虽然已经解决了这个案子,但谷歌否认了这一指控,认为它对年长的申请人不公平。

相反,该公司辩称,集体诉讼的成员未能展示出技术实力,而且文化适应的问题 - 候选人是否“足够”加入“Google” - 不是问题。

首席原告谢丽尔•菲勒克斯(Cheryl Fillekes)表示,她曾四次接受公司的面试,但由于年龄原因从未提供过工作。“年龄歧视是一个需要在科技行业解决的问题,” Fillekes的律师告诉彭博社,“我们很高兴我们能够在这种情况下为我们的客户获得公平的解决方案。”

硅谷长期以来一直在争论工作中的年龄歧视。根据研究公司Payscale的说法,Facebook员工的平均年龄是29岁,而亚马逊的平均年龄是30岁。2016年,领导苹果公司改用英特尔芯片项目的工程师据说因为Genius Bar的工作被拒绝了。该公司的高街商店之一。JK Scheinberg现在以“不要问我苹果公司”的名义发推文 - 在2016年对报告进行了支持,分享了一本关于科技时代主义的书的链接,其中包括“如果Apple最终会给我回电话天才酒吧面试“。

在谷歌的另一个和解协议中,该公司已同意支付1300万美元,以终止该公司在2010年设立街景项目时所犯的数据保护违规行为的诉讼。作为此项工作的一部分,其中涉及派遣配备相机的汽车为了试图映射美国的每条街道,谷歌也开始从家庭开车的无线网络中收集信息。

该公司的律师认为,由于无线网络是开放的,因此不应将信息视为私有。但这一论点在2013年遭遇挫折,当时联邦法院驳回了这一说法。

尽管如此,对于少数消费者来说,和解只是个好消息。律师们认为,从街头汽车放大过来收集的随机信息中追踪隐私侵权的每一个受害者都是不可能的,因此只有明确提起集体诉讼的18名原告才能获得个人赔付 。据彭博社报道,其余款项将分发给消费者隐私团体。

以上消息来源 彭博社,由AI翻译完成,仅供参考。

原文来源:https://www.theguardian.com/technology/2019/jul/22/google-pays-11m-to-jobseekers-who-alleged-age-discrimination

扫一扫 加微信

hrtechchina

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

隐私

扫一扫 加微信

hrtechchina

扫一扫 加微信

hrtechchina